対数関数の微分|基本関数の微分の公式を定義から導出する #2

指数関数、対数関数、三角関数などの微分の公式を定義から導出を行うシリーズです。#1では指数関数の微分について取り扱いました。

#2では対数関数の微分に関して取り扱いたいと思います。

以下、目次になります。

1. の微分の導出

2. の微分の導出

3. まとめ

1. の微分の導出

1節ではの微分の導出について確認します。まずは微分の定義式と比較しながら式を確認します。

上記の数式においてとすると、

、

のとき

なので下記のように変形できます。

ここまでの議論より、が成立することがわかります。

2. の微分の導出

2節ではの微分の導出について確認します。底の変換公式を用いると

は下記のように変換できます。

よって、は下記のように計算できます。

よってが成立することがわかります。

3. まとめ

#2では対数関数の定義に基づく微分について確認しました。

#3では同様に三角関数の定義に基づく微分について確認します。

指数関数の微分|基本関数の微分の公式を定義から導出する #1

微積分は数Ⅱ数Ⅲにおける重要なトピックですが、定義からの導出が比較的容易な数Ⅱの微分に対して、数Ⅲの微分はなかなか複雑です。そこで当シリーズでは基本関数の微分の公式を定義から導出を行えればと思います。

基本的には指数関数、対数関数、三角関数などを取り扱えればと思います。#1では指数関数の微分について取り扱います。

以下、目次になります。

1. の微分の導出

2. の微分の導出

3. まとめ

1. の微分の導出

1節ではの微分の導出について取り扱います。

基本的な方針は上記の1節ののオイラーによる定義と類似の変形を行います。まず準備として、

とした上で、微分の定義式に基づいて導関数を考えます。

上記の分子において、が成立し、

が

と関係ないことから下記のように変形できます。

(1)

なので、

を示すのが以下での目標になります。(オイラーの定義では

がこの式を満たすように設定するとされますが、ここでは

のみを用いることができるとします。

また、において

とすることで、

(2)

を導出することもできます。

さて、(1)式だけだとわかりにくいため、となる

を導入し、以後変形を行います(ここで

のとき、

となります)。また、

を

について解くと

のようになります。

ここまでの議論により、(1)の分子を、分母を

で置き換えると下記のようになります。

ここでは(2)式と同じ式のため、値は

になります。よって

が計算できます。

ここまでの議論により、が成立することがわかります。

2. の微分の導出

2節ではの微分の導出について確認します。基本的には

とできることより導出します。

合成関数の微分を利用することで、は下記のように導出できます。

よって、が導出できます。

1節と同様にのように変形し、

を導出することによって

を導出することもできます。

3. まとめ

#1では指数関数の定義に基づく微分について確認しました。

#2では同様に対数関数の定義に基づく微分について確認します。

数学検定準1級の問題の解説 #3

数学検定準1級の問題の解説を行うシリーズです。基礎的なトピックの確認を行うのが主目的のため、1次試験を中心に取り扱います。問題と解答は下記です。

#1では問題1〜2について、#2では問題3〜4についてそれぞれ取り扱いました。

#3では問題5〜7について取り扱います。

以下、問題5〜7についてそれぞれ確認を行います。

Answer.

同じ関数について取り扱っているので、①が解ければ②は①で導出した関数をとした際の

とすることで解ける。①の積分にあたっては、部分積分の考え方を用いる。

①の不定積分は上記より、となる。

また、これより②は

のように計算できる。

解説.

部分積分は積の導関数の公式のの両辺を積分することで、

となることと比較するとイメージがつきやすいかと思います。

(多項式関数)×(指数関数)のパターンが出題されることが多い印象です。

・問題6平面上の双曲線

の焦点の座標を求めよ。

Answer.

双曲線の方程式において、

、

としたのがここで与えられている方程式である。

よって焦点の座標はとなる。

解説.

楕円の方程式や双曲線の方程式

は抑えておくと良いかと思います。

・問題7

次の極限の値を求めよ。

Answer.の際に、

、

であるので、

は

の不定形となる。この不定形は

の因数分解の利用を用いることで解消できる。

よって元の数式の分子と分母にそれぞれをかけて不定形を解消させる。

解説.などが出てくる不定形の大概はこのような計算を行うことが多いので、慣れておくと良いと思います。また、因数分解の公式はよく出てくるのでこちらも慣れておくと良いです。

(学び直しにあたっては解けなくても解答見て理解できれば十分だと思います。)

・まとめ

#1〜#3で数学検定準1級の1次試験を確認しましたが、少々計算が複雑な問題が多かった印象です。そのため必ずしも解ける必要はない一方で、計算力の強化には適した内容だったのではないかと思われました。

数学検定準1級の問題の解説 #2

数学検定準1級の問題の解説を行うシリーズです。基礎的なトピックの確認を行うのが主目的のため、1次試験を中心に取り扱います。問題と解答は下記です。

#1では問題1〜2について取り扱いました。

#2では問題3〜4について取り扱います。

以下、問題3〜4についてそれぞれ確認を行います。

・問題3

3つの単位ベクトル,

,

が

を満たすとき、

を求めよ。

Answer.,

,

が単位ベクトルであることから、

を満たすことを利用する。

の両辺に対して

,

,

との内積を取ることで、下記の3つの式が得られる。

・ (1)

・ (2)

・ (3)

上記において、(1)式と(3)式を元にと

を

の式で表し、(2)式に代入して整理をすることで、

が得られる。

解説.

なかなか計算が複雑な問題ですが、ベクトル,

,

が単位ベクトルであることを利用すると解答のように解くことができます。

計算は大変ですが、ある程度は慣れておく方が難しい書籍などを読む際にも役に立つのではと思います。

・問題4

複素数について下記の問いに答えよ。(

は虚数単位)

① の絶対値を求めよ

② の偏角を

としたとき、

を求めよ。

Answer.

①

② ①の解答との偏角を

としたことより、

のようにできる。

ド・モアブルの定理より、が成立する。

より、

となる。

解説.

複素数に関する問題です。ド・モアブルの定理やオイラーの法則などは抑えておくと良いのではないかと思います。

・まとめ

問題3などは計算が少々複雑ですが、ある程度の計算力をつけておくと難しい書籍を読む際にも色々と役に立つので多少大変でも解けるようにしておくと良いと思います。

数学検定準1級の問題の解説 #1

〜

以前に数学検定の2級について取り扱いましたが、準1級の問題に関しても簡単な解説を行っておければということで確認を行います。高校の数ⅢCレベルなので、数学的な記載をある程度前提とする文献を読むにあたっての基礎になるレベルだと思います。

問題は1次試験の下記を確認します。(2次試験は論述で基本事項の取り扱いにあたっては不向きのため、1次試験の内容だけを取り扱うこととしました。)

一応模範解答は下記で確認ができますが、答えだけだと理解にならないので解説も含めて行います。

以下、問題1〜2について確認を行います。

・問題1

次の不等式を解け。 >

Answer.は単調減少の関数であるため、不等式を満たすには

<

が満たされれば良い。

>

>

よって上記を解いて、 <

,

>

を得る。

解説.

対数関数の底がであるのでグラフは単調減少のグラフとなります。数式だけ見て考えると間違えやすいため、グラフなども同時に描きつつ考えるとミスが少なくなると思います。

・問題2と

の間の距離を求めよ。

Answer.を

とした時に、

への垂線の

との交点を

とすると、

の長さを求めれば良い。

垂線の方程式はとなる。

この際に上記の連立方程式を解いてを得る。求める距離は、

と

の距離であるので下記のように計算できる。

解説.

かなり複雑な式変形となりましたが結果はシンプルな形となりました。の直角三角形の斜辺の長さが

であることを利用して、これに

をかけて、

を求めることもできます。

・まとめ

トピックというよりは計算が少し複雑な問題だったかもしれません。もちろん計算量の少ない解法は色々と探せば見つかりますが、時には計算力で解き切るようにもすると力がつきやすいかと思います。

↓以下簡単な宣伝ですが、教科書的な解説や基本的な問題演習がある方が望ましい方は下記を確認してみてください。数学検定2級〜準1級の話題を可能な限りシンプルにまとめました。

TransGAN|DeepLearningを用いた生成モデルの研究を俯瞰する #5

当シリーズでは生成モデルの研究や実装の俯瞰を行います。#4ではSemi-Supervised GAN(Semi-Supervised Learning with Generative Adversarial Networks)について取り扱いました。

#5では、GANにTransformerの考え方を導入した研究である、TransGAN(TransGAN: Two Transformers Can Make One Strong GAN)について取り扱います。

[2102.07074] TransGAN: Two Transformers Can Make One Strong GAN

以下目次になります。

1. TransGANの概要(Abstract、Introductionの確認)

1-1 Abstractの確認

1-2 Introductionの確認(Section1)

2. 論文の重要なポイントの抜粋

2-1. Relative Works(Section2)

2-2. Technical Approach: A Journey Towards GAN with Pure Transformers(Section3)

2-3. Comparison with State-of-the-art GANs(Section4)

2-4. Conclusions, Limitations, and Discussions(Section5)

3. まとめ

1. TransGANの概要(Abstract、Introductionの確認)

1-1 Abstractの確認

1-1節では論文のAbstractについて簡単に確認を行います。

上記がAbstractの記載ですが、要旨を下記にまとめます。

・TransformerのComputer Visionの分野への導入が取り組まれているが、GAN(generative adversarial networks)についても取り組むにあたってTransGANの研究が行われた。

・畳み込みを一切用いないで(completely free of convolutions)Transformerの処理だけに基づくarchitectureのTransGANを構築した。

・TransGANは段階的に解像度を上げる(progressively increases feature resolution)ことでmemory-friendlyなTransformer構造に基づき構築されている。

基本的には「TransformerをGANのタスクに導入した」が主題ですが、"progressively increases feature resolution"の記載は以前取り扱ったProgressive GAN(Progressive growing of gans for improved quality, stability, and variation)の研究を指していることは抑えておくと良いと思います。

Abstractについて大まかに確認できたので1-1節はここまでとし、続く1-2節では論文のSection1のIntroductionについて確認します。

1-2 Introductionの確認(Section1)

1-2節ではIntroductionをパラグラフ単位で確認を行います。

第一パラグラフでは、GANの初期研究の成功や、一貫して取り組まれてきた学習にあたっての安定化(stabilizing GAN training)の課題について紹介されています。

ここで、"Radford et al., 2015"は以前取り扱ったDCGAN(Deep Convolutional GAN)であることは抑えておくと良いと思います。

第二パラグラフでは、パフォーマンスの向上にあたって、backbone(特徴量抽出器と理解すれば良いです)に関するablation study(条件を一つずつ変えて行う実験)によりResNetやそれ以外のbackboneについて試したとされています。また、他の取り組みとして、self-attentionやstyle-based generator(StyleGAN)、自己回帰Transformerなどが挙げられています。

第三パラグラフでは、GANのbackboneを選定するにあたっての共通認識(commonsense)として、CNNの構造が基本とされていたことについて記載されています。畳み込みは強力なinductive bias(前提の構造を決めることによって学習力を高めることができるが、これをinductive biasと呼んでいる)を持つため、Computer Visionにおいては基本的に畳み込みの構造が用いられてきました。

続くパラグラフでは、畳み込みの問題点の"local receptive field"について記載されています。これによって、広い範囲の依存性(long-range dependencies)が取り扱えないとされています。これはCNNがself-attentionやnon-localな演算を用いた研究に比べ、大域的な統計量(global statistics)を取得できないという点を示唆していると考えて良いかと思います。

以下は、何箇所か抜粋して確認します。

上記はこれまで確認したCNNの問題点を解消するにあたって、pure Transformerを用いた構造をTransGANとしたとあります。

また、この研究のCotributionは上記にまとめられています。

2. 論文の重要なポイントの抜粋

2-1. Relative Works(Section2)

Generative Adversarial Networks(Section2-1)、Visual Transformer(Section2-2)、Transformer Modules for Image Generation(Section2-3)でそれぞれまとめられています。

詳しく確認すると冗長になると思われるのでここでは省略します。

2-2. Technical Approach: A Journey Towards GAN with Pure Transformers(Section3)

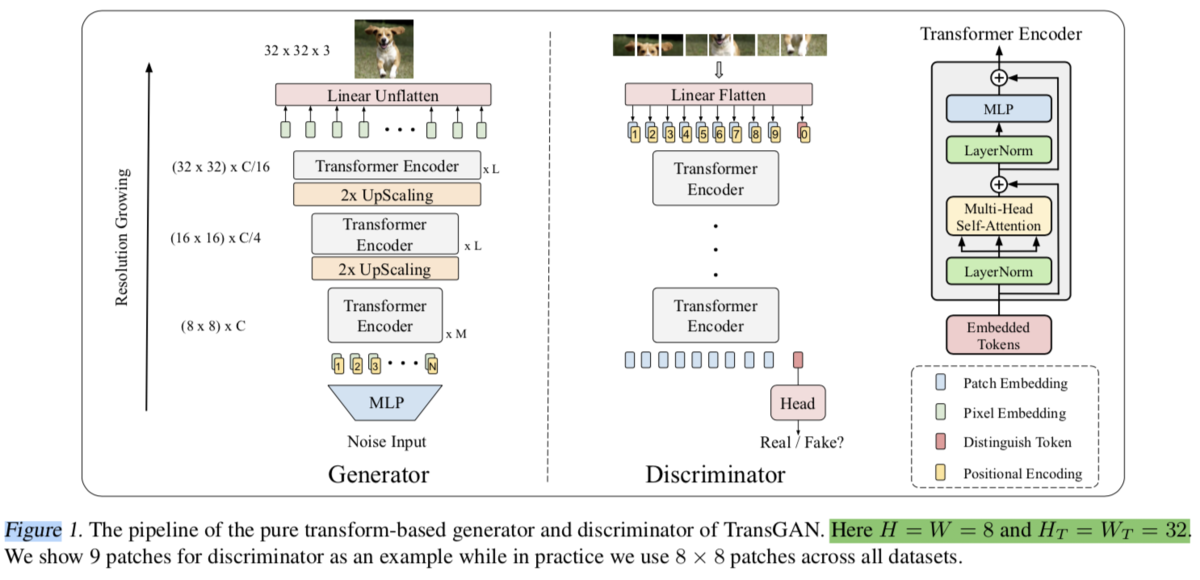

処理の全体像は上記です。Progressive GAN(Progressive growing of gans for improved quality, stability, and variation)とVisionTransformer(AN IMAGE IS WORTH 16X16 WORDS)が把握できていれば、処理の概要が把握できるかと思います。

また、論文のFigure2ではgeneratorのlossに超解像(SuperResolution)のlossを加えたことについて記載されています。

論文のFigure3では、CNNライクなinductive biasを導入するにあたって、段階的にReceptive Fieldを増やしていくことについて表されています。これによってCNNの構造的利点を活かしつつ大域的な処理も可能となるように試みたと理解して良いと思います。(関連の記載はSection3-4のLocality-Aware Initialization for Self-Attentionで記載されています)

2-3. Comparison with State-of-the-art GANs(Section4)

2-4. Conclusions, Limitations, and Discussions(Section5)

当記事では省略します。

3. まとめ

#5ではTransGAN(TransGAN: Two Transformers Can Make One Strong GAN)について取り扱いました。

#6以降でも引き続き関連の研究について確認できればと思います。

プロパガンダとメディア|政治とプロパガンダ #2

「政治とプロパガンダ」について取り扱うシリーズです。#1ではプロパガンダの概要や主な手法についてざっくりと確認しました。

#2ではプロパガンダとメディアについて取り扱います。基本的にはWikipediaの記載を参考に、シンプルにまとめられたらと思います(プロパガンダ - Wikipedia)。

以下、当記事の目次になります。

1. テレビ・ラジオ・新聞報道を用いたプロパガンダ

2. 映画・芸術を用いたプロパガンダ

3. 集会・イベントやインターネットを用いたプロパガンダ

4. 建国神話・英雄譚・伝説・学説の利用

5. まとめ

1. テレビ・ラジオ・新聞報道を用いたプロパガンダ

1節ではテレビ・ラジオ・新聞報道を用いたプロパガンダについて取り扱います。基本的には「マスメディアをどのようにプロパガンダに用いるか」の視点で考えておくと良さそうです。

テレビとラジオはデバイス的な意味でのメディアの進化のタイミングと世界史を関連付けるとわかりやすく、ラジオは第二次世界大戦頃のナチスドイツや大日本帝国、テレビは冷戦時のソ連で行われたプロパガンダが有名な例と考えておくのが良いと思います。

上記のように特にナチスドイツではラジオの市場価格を下げてでもラジオの普及を推奨したなどからも、いかにメディアを活用するかが重視されていることがわかります。ナチスドイツのプロパガンダやそれを主導した宣伝大臣のゲッペルスはこの辺りの世界史を考察する上で重要です。また、大日本帝国では国営の放送局しかなく、それが政府の宣伝機関として機能していたということは抑えておくと良さそうです。

上記はソ連のテレビを用いたプロパガンダですが、ラジオと異なるのは映像が主となるということです。このことにより、プロパガンダが逆効果になったソ連の例などもあります。

新聞報道や出版社に関しては、「言論統制により新聞や書籍でもプロパガンダ的手法がとられる場合がある」とされています。ここでよくありがちな主張に、「中立性を保つべきだ」というのがありますが、アメリカでは逆に新聞社の立場が「保守」と「リベラル」に分かれることが許容されるかつ当然視されていることがなかなか興味深いです。というのも、株主や広告主などの資金源や新聞社の思想背景、記者の個人的信条などが原因で「完全な中立」は難しいためです。そのため、ある程度報道や出版にあたっては立場を明示する方が逆に受け取り側が中立性を判断しやすくなるかと思われます。

1節では主にマスメディアに関連するテレビ・ラジオ・新聞報道を用いたプロパガンダについて取り扱いました。続く2節では映画・芸術を用いたプロパガンダについて取り扱います。

2. 映画・芸術を用いたプロパガンダ

2節では映画・芸術を用いたプロパガンダについて取り扱います。

映画を用いたプロパガンダは国家や軍、政治団体やその支援者などが映画を直接製作したり積極的に協力したりすることで行われます。世界史的にはレーニンの共産主義プロパガンダ映画などが有名と抑えておくのが良さそうです。

プロパガンダに芸術を用いる手法については、大日本帝国やナチス政権下のドイツが例として挙げられています。第二次世界大戦中の大日本帝国では、芸術家を国家の統制管理下におき、反体制主義の芸術家を投獄することで表現を国家統制に用いたとされています。

2節では映画・芸術を用いたプロパガンダについて取り扱いました。事実上の独裁政権の統制強化のために芸術的表現を利用するというのが主な流れのようでした。

3. 集会・イベントやインターネットを用いたプロパガンダ

3節では集会・イベントやインターネットを用いたプロパガンダについて取り扱います。

集会・イベントを用いたプロパガンダでは「会場の規模」や「装飾」などの豪華さ・贅沢さを見せつけ権威性を演出したり、貧弱のものを見せつけることで大衆の味方であるように装ったりされます。この辺りのメディアの演出は現代でも少なからず行われていると思われるため、一定程度注意が必要だと思われます。

また、上記がインターネットを用いたプロパガンダの具体例です。立場を偽り、中立を装って、多数派に見せかける工作を行うのが基本的な手法だと抑えておくのが良さそうです。また、都合の良くない発信は削除させるように圧力をかけるというのもプロパガンダの手法として用いられるようです。

4. 建国神話・英雄譚・伝説・学説の利用

4節では「建国神話・英雄譚・伝説・学説の利用」について取り扱います。

上記では「建国神話は国家の正当性を表すため、重要な位置を占める」とされています。日本では、古事記や日本書紀、神風などが大日本帝国時に用いられたとされています。またここで革命により成立した人口国家のアメリカ合衆国、ソビエト連邦、中華人民共和国、中華民国では神話を持たないとされているのもなかなか興味深いです。

5. まとめ

#2ではプロパガンダとメディアについて取り扱いました。20世紀はマスメディア中心だったプロパガンダが近年ではインターネットの普及などにより個々に向けた発信が多くなってきたことには注意が必要だと思われました。

#3では憲法改正とプロパガンダについて取り扱います。