XAIの概要を把握する|DeepLearningに関するXAIの手法 #3

当シリーズではXAIの研究の概要の把握を行います。#2ではLIMEとSHAPに関して確認を行いました。

#3では#1で確認を行なったSurveyを元に、DeepLearningに関するModel-Specificな解釈に関して取り扱いを行います。

以下が目次となります。

1. Multi-Layer Neural Networks

2. Convolutional Neural Networks

3. Recurrent Neural Networks

4. 体系的な理解

5. まとめ

1. Multi-Layer Neural Networks

1節ではSurveyのSection4.3.1を元に、Multi-Layer Neural Networksに関して取り扱いを行います。

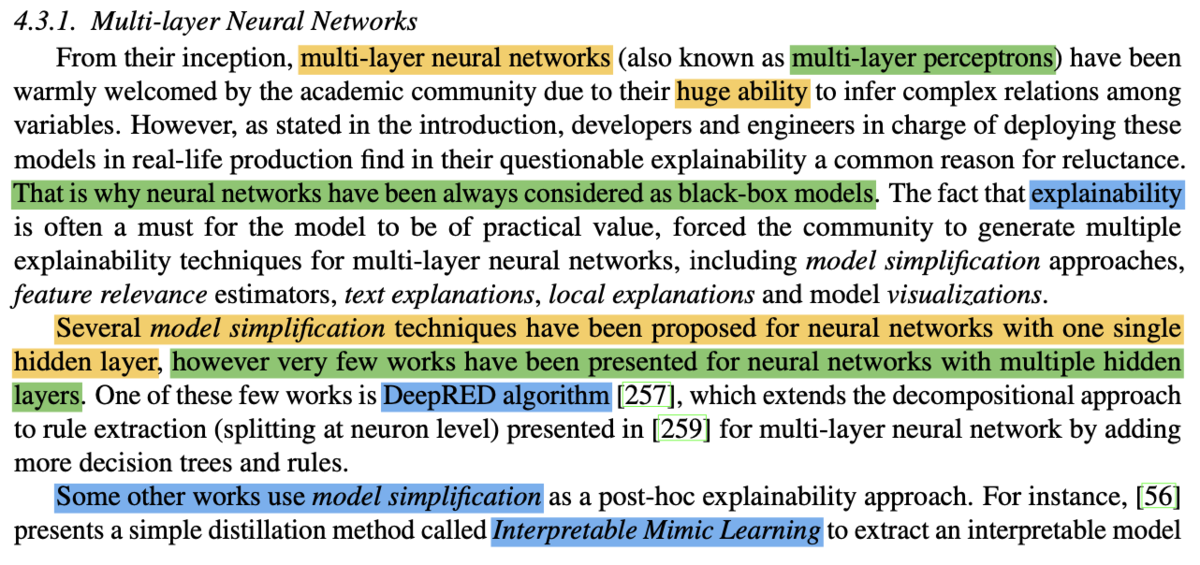

第1パラグラフの記載を確認することで、Multi-Layer Neural NetworksはMulti-Layer Perceptronと同じ意味で用いられていることが確認できます。

また、第2パラグラフではmodel simplificationに関する手法のDeepRedが挙げられており、続く第3パラグラフではInterpretable Mimic Learningが挙げられています。

その他にもDeepLIFTなどがmodel simplificationの例に紹介されています。

2. Convolutional Neural Networks

2節ではSection4.3.2の内容を元にCNNに関して確認を行います。

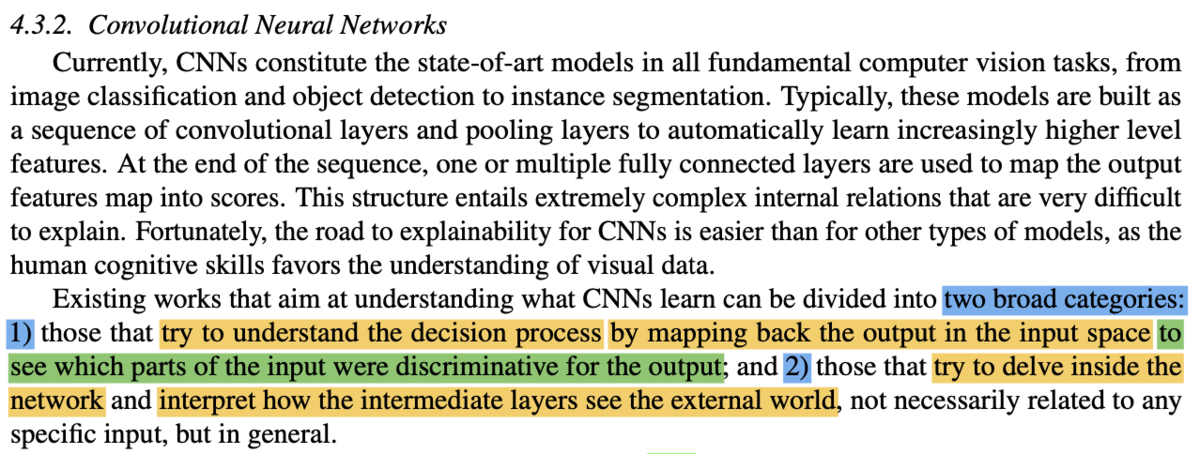

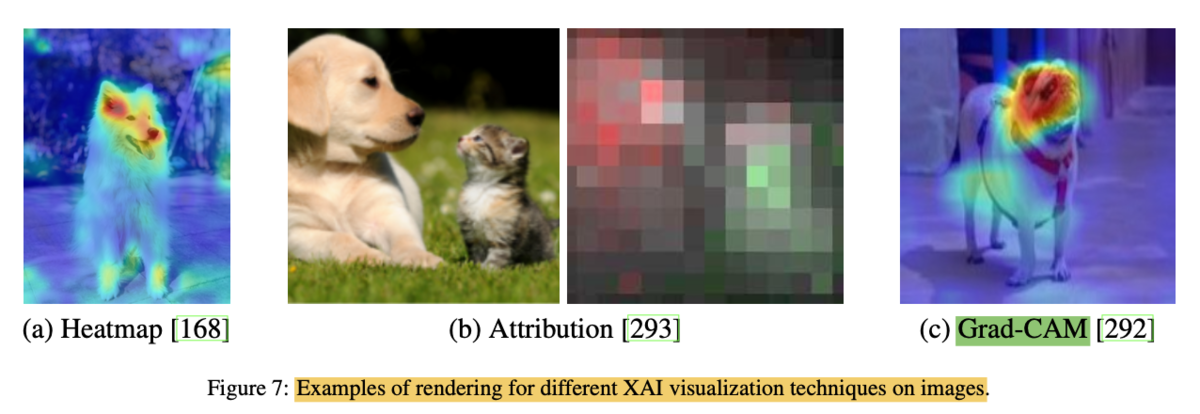

第2パラグラフを確認すると、CNNの理解に関する研究は「① 出力結果を判別するにあたって用いられた部分を確認するにあたって、入力空間にヒートマップを描き、意思決定過程を理解する」研究と、「② ニューラルネットワーク内部の挙動を掘り下げる(delve)」研究の二つに大別されるという記載があります。①の研究の具体的な例にGrad-CAM(Visual explanations from deep networks via gradient-based localization)があることは抑えておくと良いと思います。

Grad-CAMの概要は上記で表したFigure.7などで示されているので、こちらで大体の概要が掴めると思います。

②の研究に関しては、Deep Generator Network(DGN)などが例に挙げられています。

3. Recurrent Neural Networks

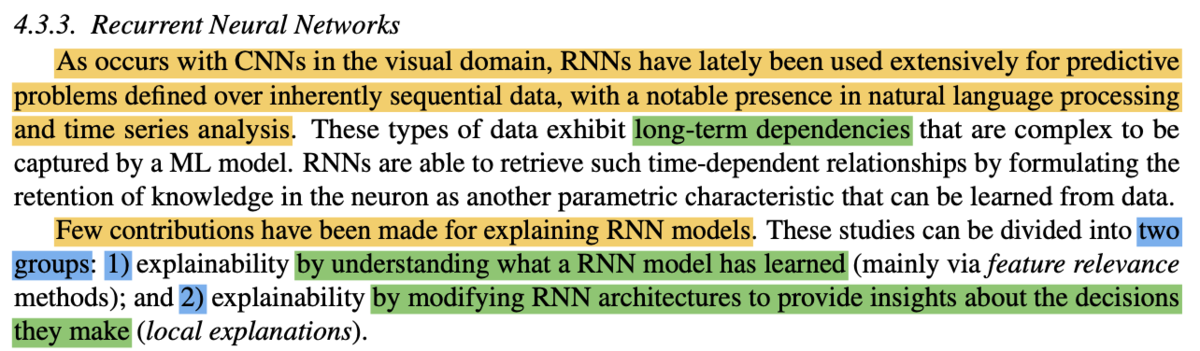

3節ではSection4.3.3の内容を元にRNNに関して確認を行います。

第2パラグラフを確認することで、model-agnosticで取り扱われた「①単純化(simplification)に基づく手法」と「②特徴量の関連に基づく手法」のような汎用的な考え方に概ね基づき、RNNの解釈に関する論文が大別されることが確認できます。

4. 体系的な理解

4節ではSurveyのSection4.4の内容の確認を行います。

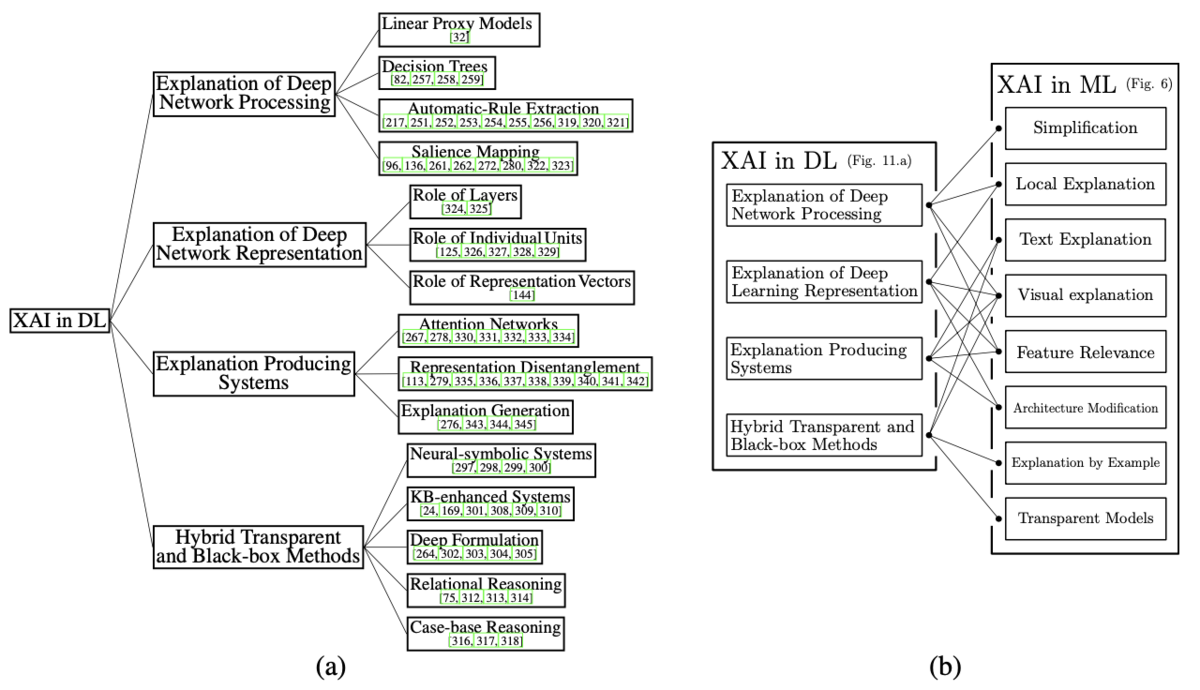

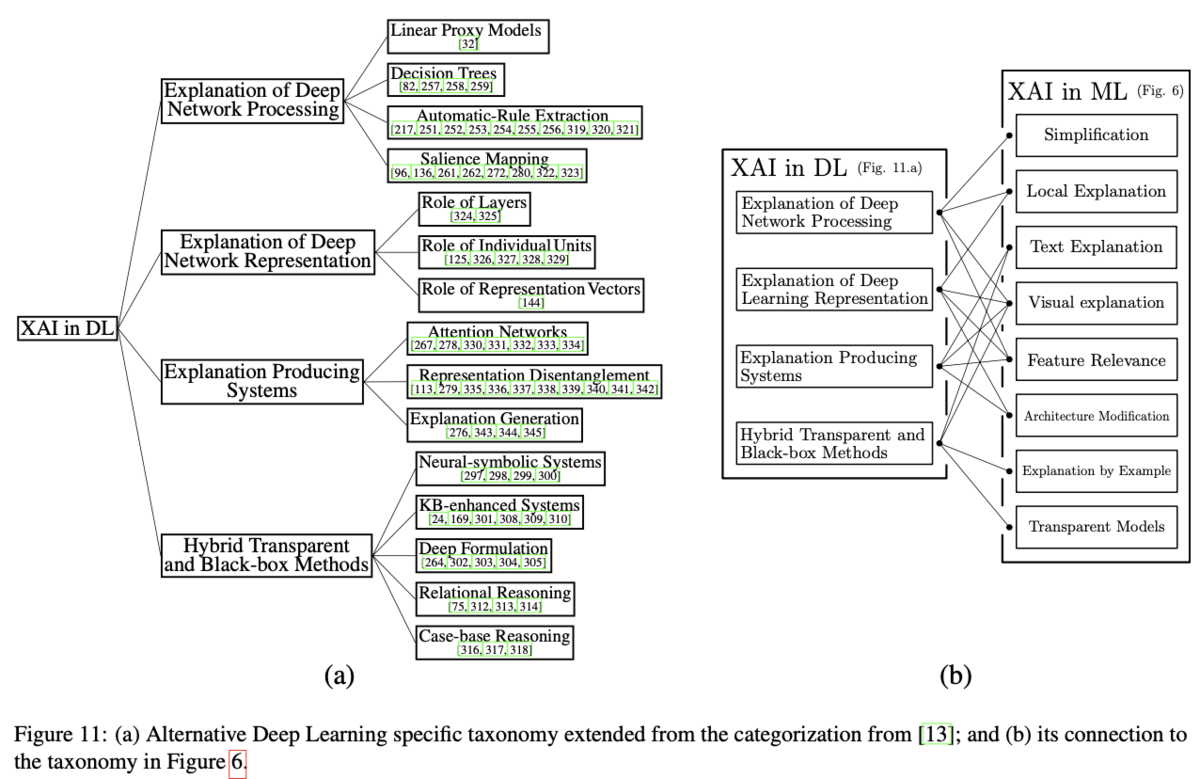

上記で示したFigure.11では、"Explaining Explanations: An Overview of Interpretability of Machine Learning"の内容を元に、DeepLearningの体系(taxonomy)が提示されます。

[1806.00069] Explaining Explanations: An Overview of Interpretability of Machine Learning

Surveyの記載だけで読み解くのは少々難しそうなので、詳細の確認は必要に応じて別途行おうと思います。

5. まとめ

#3ではXAIのSurveyからDeepLearningに関連する記載の確認を行いました。

#4では2節で確認を行なったDeepLIFT(Deep Learning Important Features)と、3節で確認を行なったGrad-CAMの論文の内容の確認を行います。