Progressive Growing of GANs②(PROGRESSIVE GROWING OF GANS以降)|Style Transferの研究を俯瞰する #8

2019年にNVIDIAが公開して話題になったStyle GANにもあるように、生成モデルへのStyle Transferの研究の導入が注目されています。当シリーズではそれを受けて、Style Transferの研究を俯瞰しながらStyle GANやStyle GAN2などの研究を取り扱っていきます。

#1、#2ではStyle Transfer関連の初期の研究である、Image Style Transferについて、#3、4ではAdaINについて、#5、#6ではStyleGANについて取り扱いました。

AdaIN①(Abstract&Introduction)|Style Transferの研究を俯瞰する #3 - Liberal Art’s diary

#7、#8ではStyleGANの研究でベースラインとして比較されていたPGGAN(Progressive Growing of GANs for Improved Quality, Stability, and Variation)について取り扱います。

[1710.10196] Progressive Growing of GANs for Improved Quality, Stability, and Variation

#7ではAbstractとIntroductionの確認を行いました。

Progressive Growing of GANs①(Abstract&Introduction)|Style Transferの研究を俯瞰する #7 - Liberal Art’s diary

#8ではPROGRESSIVE GROWING OF GANS以降の内容の確認を行います。

以下目次になります。

1. PROGRESSIVE GROWING OF GANS(Section2)

2. INCREASING VARIATION USING MINIBATCH STANDARD DEVIATION(Section3)

3. NORMALIZATION IN GENERATOR AND DISCRIMINATOR(Section4)

4. MULTI-SCALE STATISTICAL SIMILARITY FOR ASSESSING GAN RESULTS(Section5)

5. EXPERIMENTS(Section6)

6. DISCUSSION(Section7)

7. まとめ

1. PROGRESSIVE GROWING OF GANS(Section2)

1節ではSection2のPROGRESSIVE GROWING OF GANSについて取り扱います。

第一パラグラフでは、低解像度(low-resolution)の画像から徐々に解像度を上げて学習を行う、Progressive Growing of GANsの処理の概要について記載されています。従来の全て同時に学習する手法とは異なり、まず大まかな画像の構造を学習しその次に詳細を学習することができると記載されています。

また、処理概要に関連してFigure1の処理の全体像も紹介されています。左の図では左からTraining progressの矢印にしたがって、生成ネットワーク(Generator)と識別ネットワーク(Discriminator)に徐々にレイヤーを追加していくプロセスについて記載されており、これによって生成される画像の解像度を上げることができるとなっています。この時、低解像度から学習させることによって学習の高速化が実現できるともされています。また、図の右側は生成した1024×1024の画像のサンプルが紹介されています。

第二パラグラフでは、生成ネットワーク(Generator)と識別ネットワーク(Discriminator)を対称的に作成し、同調しながら学習させるとなっています。また、新しいレイヤーを追加する際の処理についてもFigure2にまとめたとされており、なるべく急なレイヤーの追加による影響を小さくするように試みているとされています。

上記のFigure2では、GeneratorやDiscriminatorに新しいレイヤーを追加するにあたっての詳細について記載されています。図では(a)で記載されている16×16の状況から(c)で記載されている32×32の処理への移行の過程について記載されています。移行にあたって(b)では、ResNetで用いられているResidual Blockと類似の処理を行なって、新しいレイヤーからの出力を利用する率であるを0から1に向けて徐々に大きくしていくと記載されています。また、Discriminatorの学習にあたっては、実際の画像をその時点でのDiscriminatorが取り扱う画像の解像度に下げて学習を行なっていく(downscaled to match the current resolution of the network)とされています。

第三パラグラフではPGGANの利点として安定性と学習の高速化が挙げられており、第四パラグラフでは関連研究について言及されています。

2. INCREASING VARIATION USING MINIBATCH STANDARD DEVIATION(Section3)

3. NORMALIZATION IN GENERATOR AND DISCRIMINATOR(Section4)

4. MULTI-SCALE STATISTICAL SIMILARITY FOR ASSESSING GAN RESULTS(Section5)

今回は省略します。

5. EXPERIMENTS(Section6)

5節ではSection6のEXPERIMENTSについて確認します。

上記が冒頭部の記載ですが、Experimentsではこの研究における質の評価を行うためにいくつかの実験を行なったとされています。また、実験で用いたネットワークの構造や学習の設定についてはAppendixのAでまとめているとなっています。

AppendixのAのTable2ではPGGANの研究でCelebA-HQを用いて1024×1024の画像が生成できるように学習させるのに用いたネットワークの全体となっています。Generatorの記載では4×4から始まり、8×8、16×16、32×32、64×64、128×128、256×256、512×512、1024×1024のように徐々にUpsamplingを行なっている過程について確認ができます。パラメータはGeneratorとDiscriminatorのどちらも2,300万となっており、1億を超えているVGGなどよりは小さい数となっています。その他の細かい設定についてはAppendixのAにまとめられています。

本文に戻り、Section6.1ではSWD(Sliced Wasserstein distance)とMS-SSIM(multi-scale structural similarity)という二つの指標の比較を行なっています。

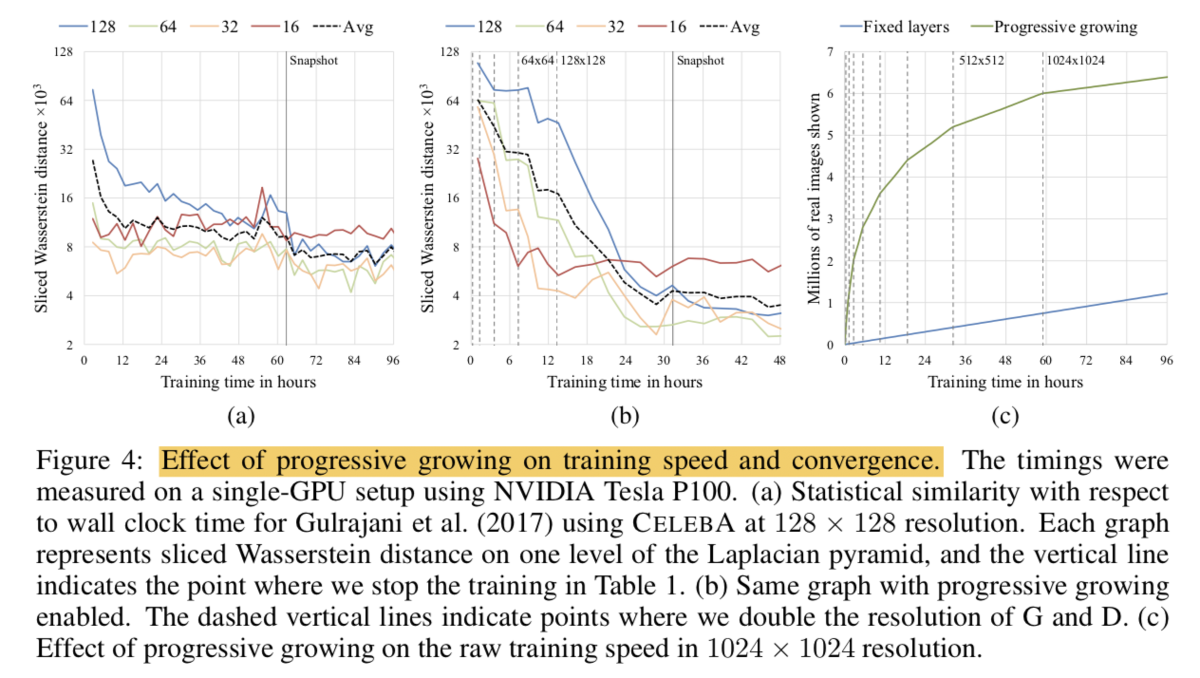

Section6.2では収束や学習の速度について論じられています。

Section6.3では生成された画像について紹介されています。

6. DISCUSSION(Section7)

省略します。

7. まとめ

#8ではPGGAN(Progressive Growing of GANs for Improved Quality, Stability, and Variation)のSection2のPROGRESSIVE GROWING OF GANS以降の内容の確認を行いました。

#9以降では2019年に出されたStyleGAN2についての論文である、Analyzing and Improving the Image Quality of StyleGANについて取り扱います。

[1912.04958] Analyzing and Improving the Image Quality of StyleGAN