Word2Vec③(Results)|言語処理へのDeepLearningの導入の研究トレンドを俯瞰する #20

言語処理へのDeepLearningの導入をご紹介するにあたって、#3〜#8においては、Transformer[2017]やBERT[2018]について、#9~#10ではXLNet[2019]について、#11~#12ではTransformer-XL[2019]について、#13~#17ではRoBERTa[2019]について取り扱ってきました。

Transformer-XL(論文のAbstractの確認)|言語処理へのDeepLearningの導入の研究トレンドを俯瞰する #12 - lib-arts’s diary

#18以降ではSeq2Seq以前の論文は解説書などで把握しただけだったので、もう少し詳しく見てみれればということで、手始めとしてWord2Vec[2013]を取り扱っています。

[1301.3781] Efficient Estimation of Word Representations in Vector Space

#18では上記のWord2Vec[2013]の論文のAbstractとIntroductionを、#19は論文のModel ArchitecturesとNew Log-linear Modelsを確認しました。

Word2Vec①(論文の概要 Abstract&Introduction)|言語処理へのDeepLearningの導入の研究トレンドを俯瞰する #18 - lib-arts’s diary

#19では引き続き同論文のSection4のResultsについて取り扱っていきます。

以下目次になります。

1. Results(Section4)

1-1. Task Description(Section4-1)

1-2. Maximization of Accuracy(Section4-2)

1-3. Comparison of Model Architectures(Section4-3)

1-4. Large Scale Parallel Training of Models(Section4-4)

1-5. Microsoft Research Sentence Completion Challenge(Section4-5)

2. まとめ

1. Results(Section4)

Section4のResultsについて取り扱うにあたって、まずは冒頭部を確認していきます。

以下パラグラフ単位で確認していきます。

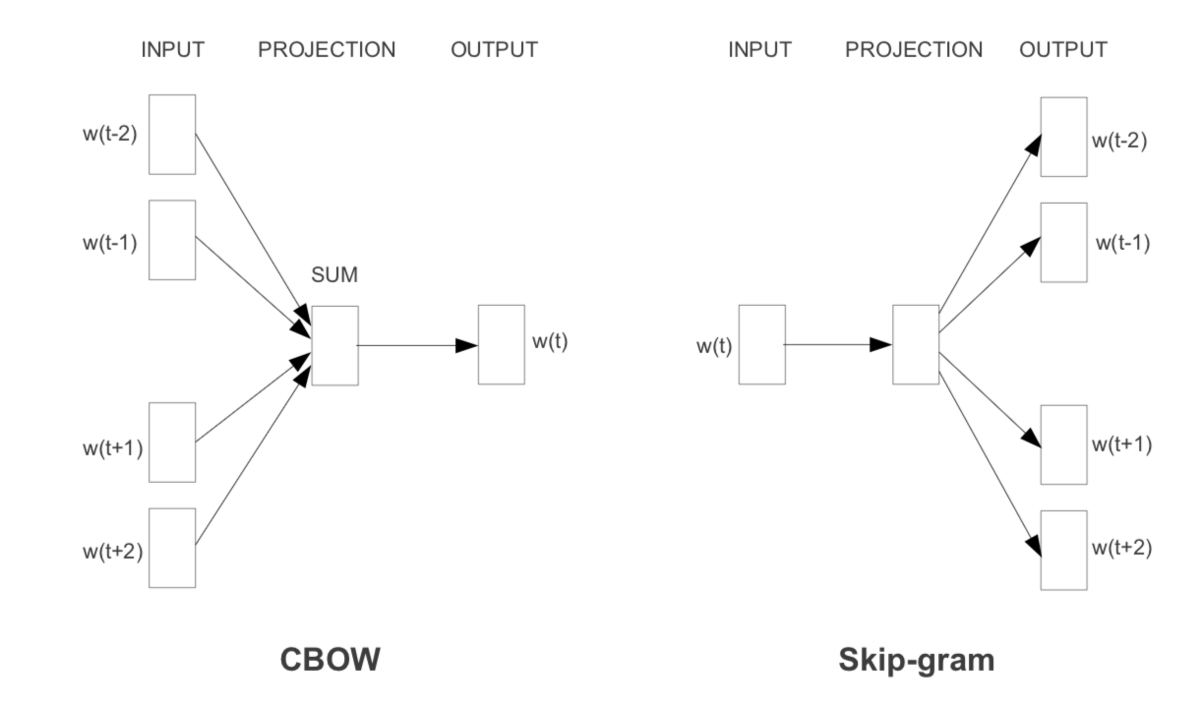

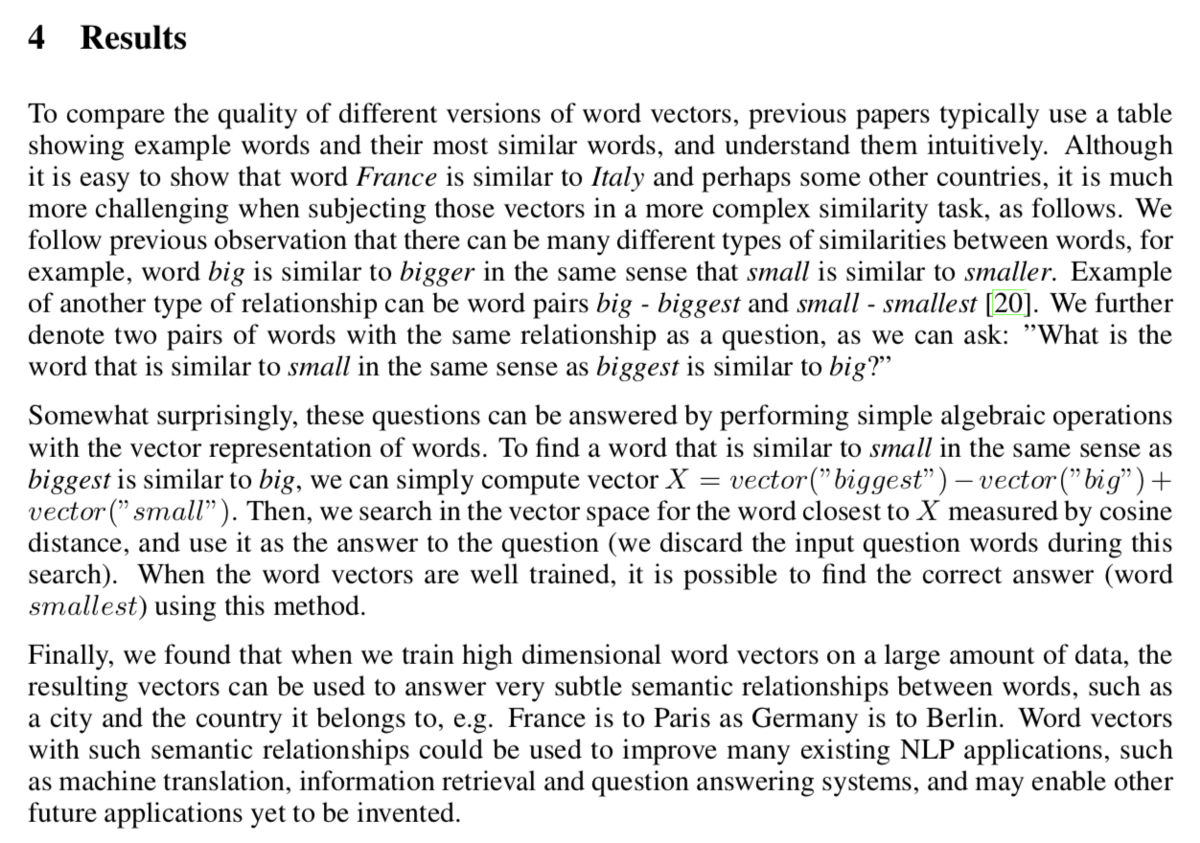

第一パラグラフでは、word vectorsの手法間の質の比較についてまとめられています。従来の論文ではある単語と最も近い単語の対応表を用いて直感的に判断を行っていたとされています。このやり方ではFranceとItalyが近いことがわかってもどう近いかまではわからないので、bigとbiggerの関係がsmallとsmallerの関係に近いことがわかる方がよりchallengingだとされています。したがってbig-biggestとsmall-xが同じ関係のとき、xに入るのが何かと聞くようにしたとあります。

第二パラグラフでは、第一パラグラフの関係性を表現するにあたって、単語のベクトル表現のシンプルな代数演算(simple algebraic operations)を用いることで可能にできるとされています。すなわちのように計算式で表現できるということです。この際にしっかりと単語ベクトルが学習されていれば、Xと近しい単語をcos類似度を用いて求めることができるとされています。

第三パラグラフでは、大きなデータセットを用いた際に学習がうまくいき、France-ParisやGermany-Berlinのような関係を表現できたとされています。意味的な関係をもった単語ベクトルは多くの言語処理の応用を改善させることができ、例として機械翻訳(machine translation)、情報検索(information retrieval)、質問応答(question answering)などのタスクが挙げられています。

1-1. Task Description(Section4-1)

1-1節ではSection4-1のTask Descriptionを確認していきます。

以下パラグラフ単位で確認していきます。

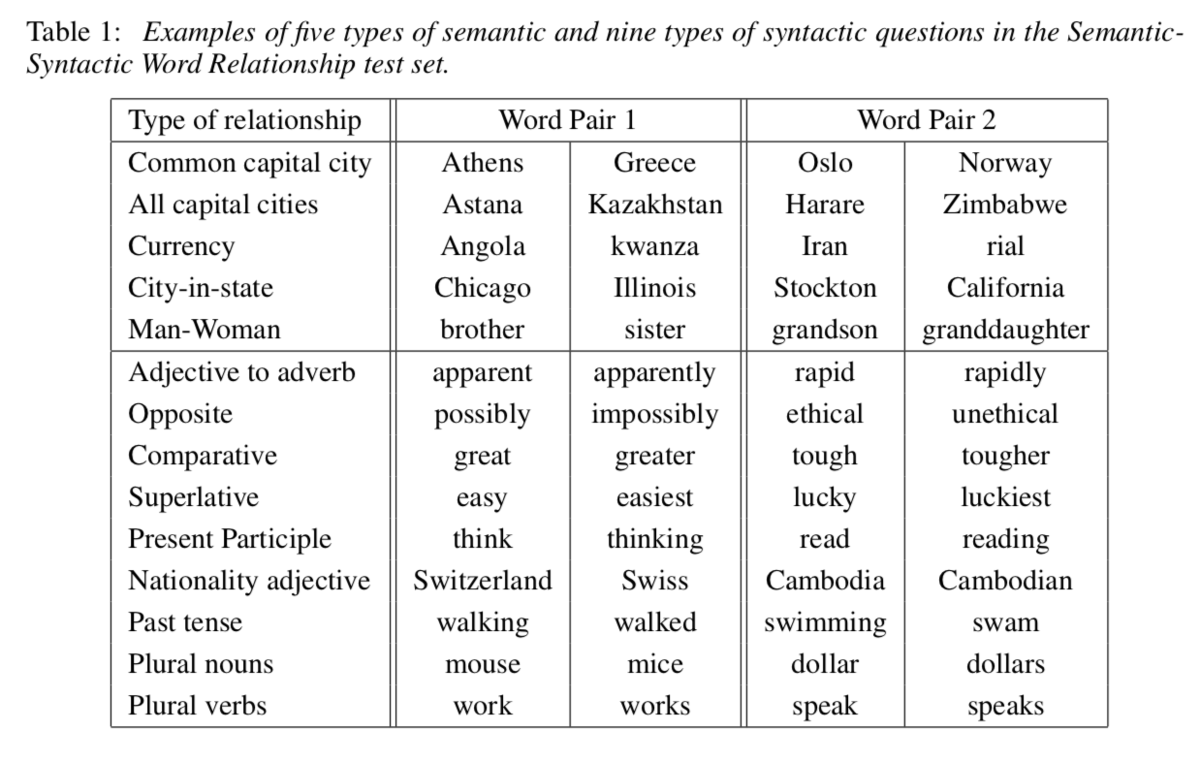

第一パラグラフでは、単語ベクトルの質を図るために5種の意味的な質問と9種の構文的質問を含めた理解テストを定義したとされています。下記のTable1にそれぞれの関係の二つの例を記載したとあります。

Table1において、首都(capital city)や形容詞と副詞(Adjective to adverb)などの例が記載されていることがわかります。全体的には8,869の意味的な質問と10,675の文法的な質問があり、これらの質問は(1)手動で類似の単語の組みを作成する、(2)二つの単語ペアを連結する、の二つのステップを踏んで生成されるとされています。

第二パラグラフでは、これらの定義したタスクに対して評価を行ったとされています。

1-2. Maximization of Accuracy(Section4-2)

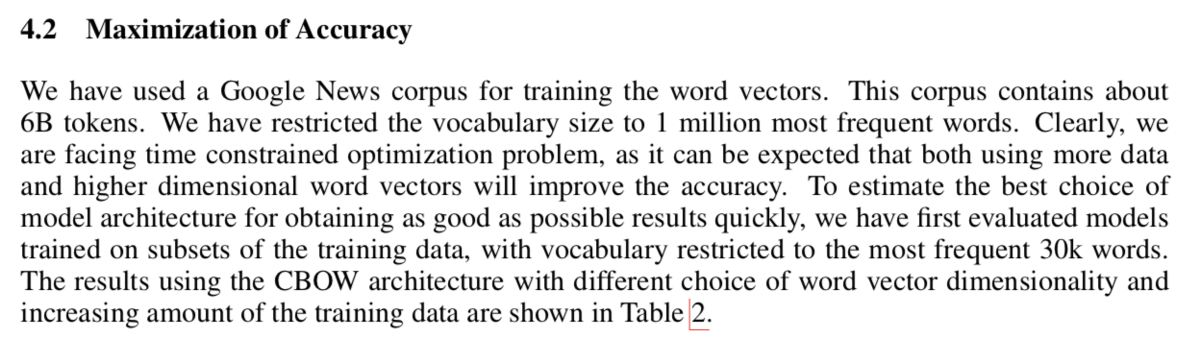

1-2節ではSection4-2のMaximization of Accuracyを確認していきます。以下パラグラフ単位で確認していきます。

第一パラグラフでは、単語ベクトルの学習にあたっての精度の最大化において、60億の単語を含んだGoogle Newsのコーパスを用い、そのうちでよく用いられている100万単語の語彙(vocabulary)に制限して単語ベクトルを生成したとされています。

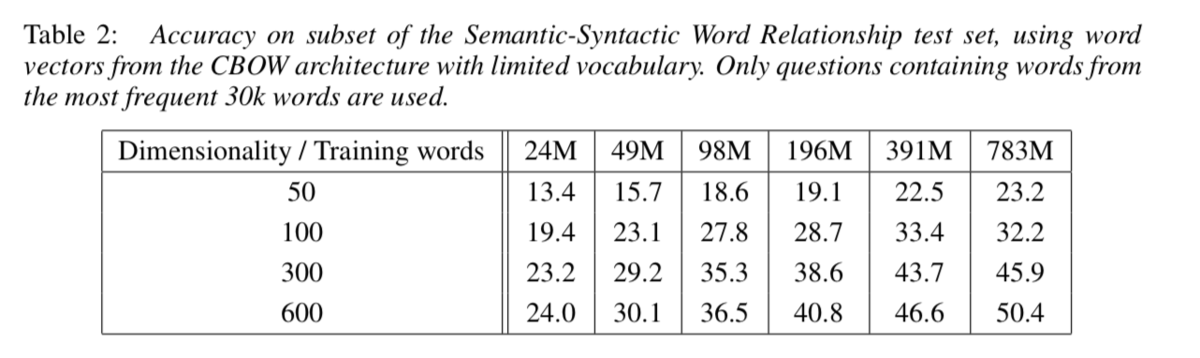

また、CBOWを用いた学習結果(正答率)について、Table2で表したとされています。隠れ層の次元(Dimensionality)や学習データの量(Traning words)が大きくなるにしたがって正答率(acccuracy)が改善されたとされています。

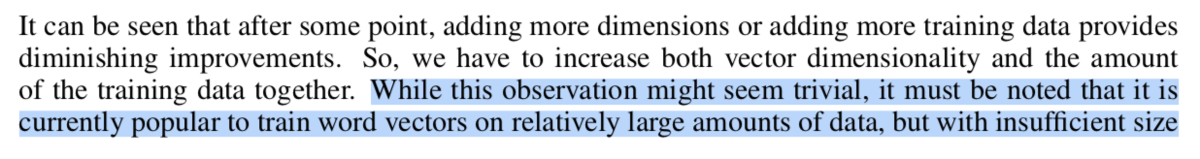

第二パラグラフでは、データサイズやdimensionalityについてさらにコメントされています。

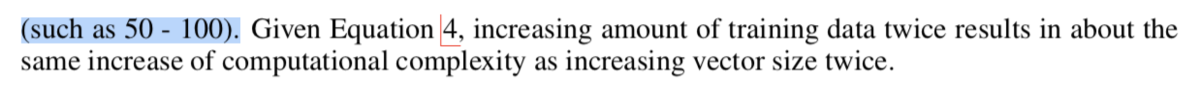

第三パラグラフでは、Table2やTable4の実験において、確率的勾配降下法(stochastic gradient descent)において3つの学習エポックを用いたとされています。

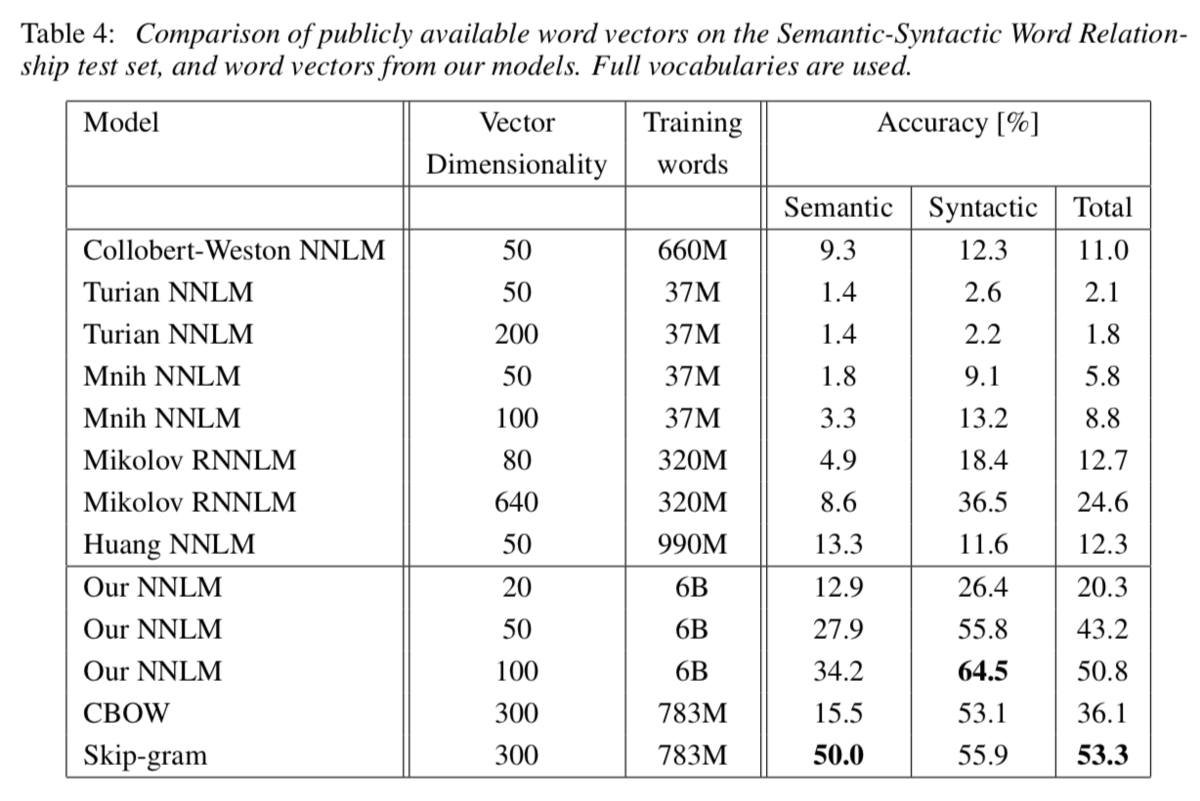

また、Table4においては上記のように様々なモデル間の精度の比較を行っています。

1-3. Comparison of Model Architectures(Section4-3)

Section4-3のComparison of Model Architecturesでは様々なモデルを比較したとあります。

Table3ではRNNLM、NNLM、CBOW、Skip-gramの比較を行っています。

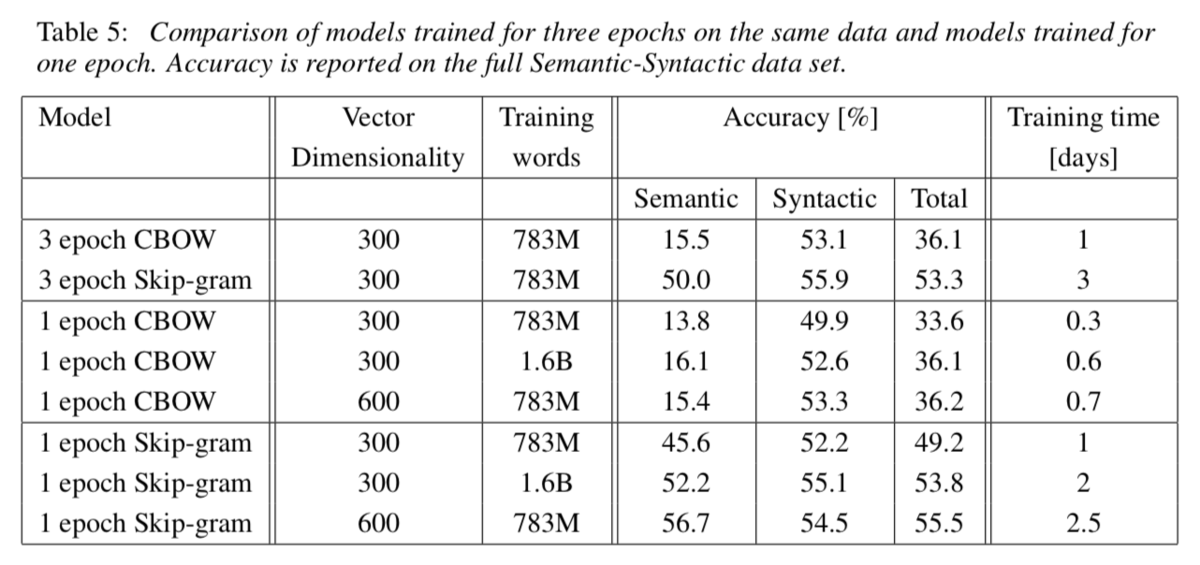

また、前節で示したTable4に加え、上記のTable5などについてもパフォーマンスの比較が行われています。様々な条件化で比較が行われていますが、CBOWやSkip-gramは全体的に良いパフォーマンスを示していることが確認できます。

1-4. Large Scale Parallel Training of Models(Section4-4)

Section4-4のLarge Scale Parallel Training of Modelsでは学習の並列化についてまとめられています。

実験結果としては上記のTable6にまとめられています。NNLMに比べてCBOWやSkip-gramの計算コストが低いことが確認できます。

1-5. Microsoft Research Sentence Completion Challenge(Section4-5)

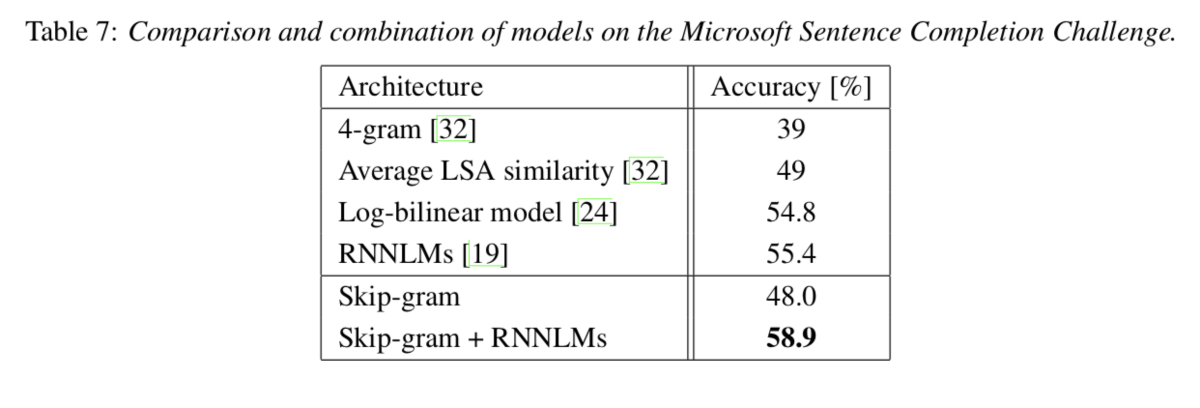

Section4-5ではMicrosoft Research Sentence Completion Challengeにおける結果についてまとめられています。

結果は上記のTable7にまとめられています。Skip-gramを導入した手法の(Skip-gram + RNNLMs)が一番良いAccuracyとなっていることが確認できます。

2. まとめ

#20ではSection4のResultsについて取り扱いました。大体の内容は取り扱えたのでWord2Vecの論文についてはここまでとします。

#21からは、GLUEベンチマークにおいてRoBERTaを上回る新たなSotAを出した2019年9月に出されたALBERTについて取り扱っていきます。